GPT-OSS-20B简介

R

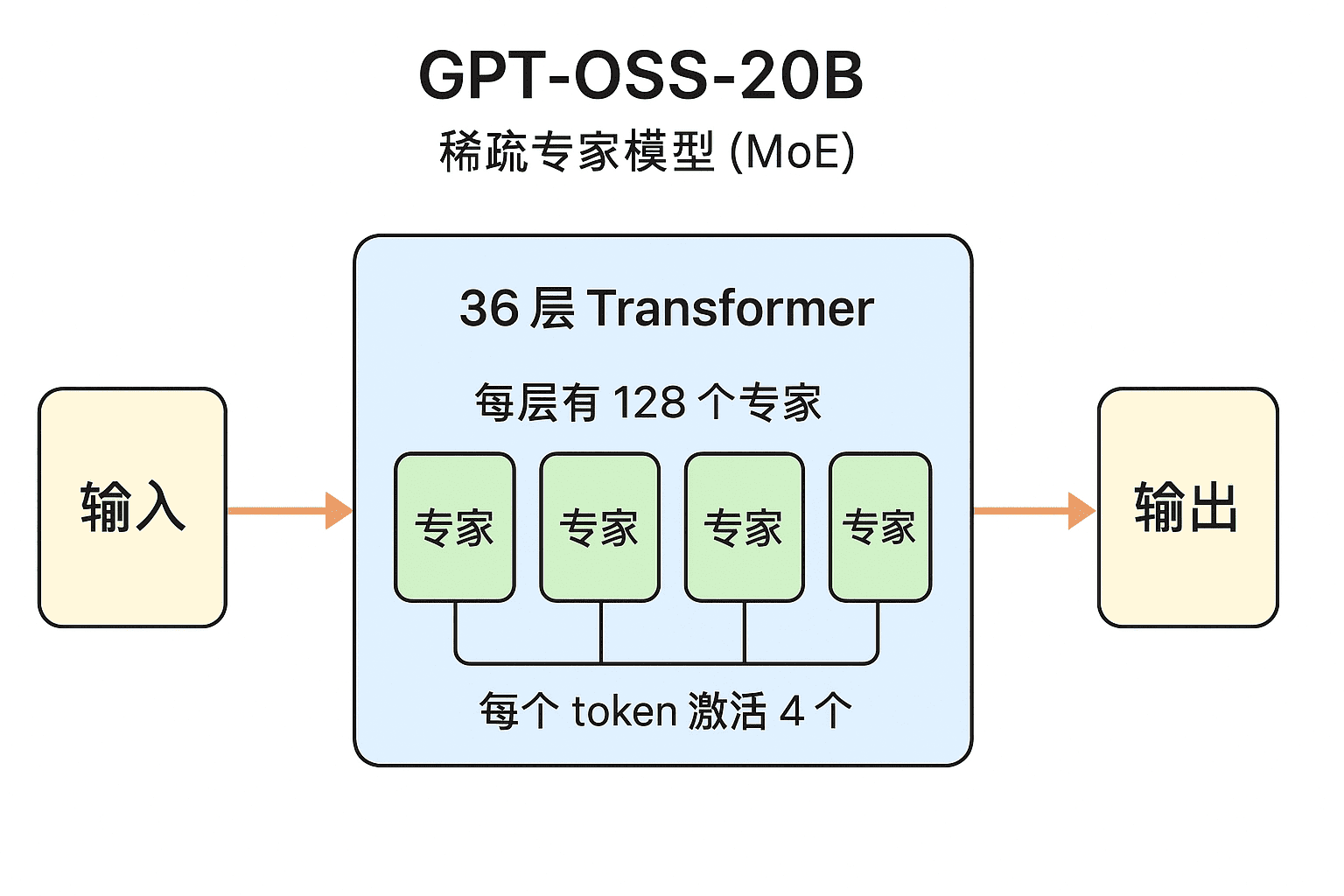

ryan j November 10, 2025GPT-OSS-20B 是 OpenAI 发布的一款 开源大语言模型(OSS = Open-Source Series),参数量约 200 亿(20B),采用 稀疏专家模型(MoE, Mixture of Experts) 架构。

它的主要特点:

- 架构:36 层 Transformer,每一层有 128 个专家(Experts),但每次只激活 4 个,这样既保留了容量又降低了计算成本。

- 优势:在推理时只调用部分专家,能在同等算力下获得更大的模型容量和更好的性能。

- 用途:适合科研、二次开发、领域微调等,尤其在需要开源可控的场景下。

- 开源:提供了模型权重与推理代码,允许开发者在本地或云端部署。

性能对比 GPT-3.5

- 上下文长度 & 实时响应 gpt-oss-20b 支持长达 131K token 的上下文输入,相比 GPT-3.5 Turbo 的 16K token 有明显提升。此外,在推理速度和成本方面,也更具优势。

- 信息更新 GPT-3.5 的训练数据截止至 2021 年 9 月,而 gpt-oss-20b 的最新训练数据更新至 2024 年 4 月,知识基础更加新颖。

性能对比 GPT-4omini

在数学推导、代码生成、工具调用等基准测试中,整体接近 GPT-4o mini 水平

本地运行

可以运行在16G显存的设备上。

如果要达到可以支持的131Ktoken上下文,需要更多显存。